La entropía es el único concepto de la física que distingue el pasado del futuro. Y sin embargo, casi nadie sabe bien qué es.

El café se enfría. El perfume se dispersa. Los cristales se rompen pero no se recomponen solos. Todos estos fenómenos cotidianos tienen algo en común: ocurren siempre en una dirección. Y esa dirección la marca la entropía.

Coloquialmente se dice que la entropía es una medida del desorden: cuanto más desordenado o disperso está un sistema, mayor entropía tiene. Esta idea es útil como primera aproximación, pero es demasiado simplificada y puede llevar a confusiones graves. Por ejemplo, un agujero negro es un objeto extremadamente compacto —aparentemente muy «ordenado»— y sin embargo posee una entropía colosal. Para entender por qué, hay que ir un poco más al fondo.

¿En qué unidades se mide la entropía?

Una buena forma de empezar es fijarse en las dimensiones físicas de un concepto. La entropía se mide en julios por kelvin (J/K), lo que ya nos da una pista importante: está relacionada con la energía y con la temperatura.

En termodinámica, la definición clásica del cambio de entropía es:

dS = dQ / T

donde dQ es el calor intercambiado de forma reversible y T es la temperatura absoluta. Esta expresión nos indica que la entropía mide cuánta energía térmica se intercambia por cada grado de temperatura. O dicho de otra manera: mide cómo se reparte la energía térmica en el sistema a una temperatura dada.

El ejemplo del hielo: tres actos

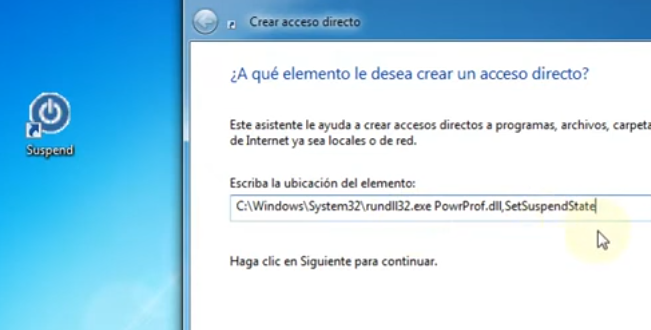

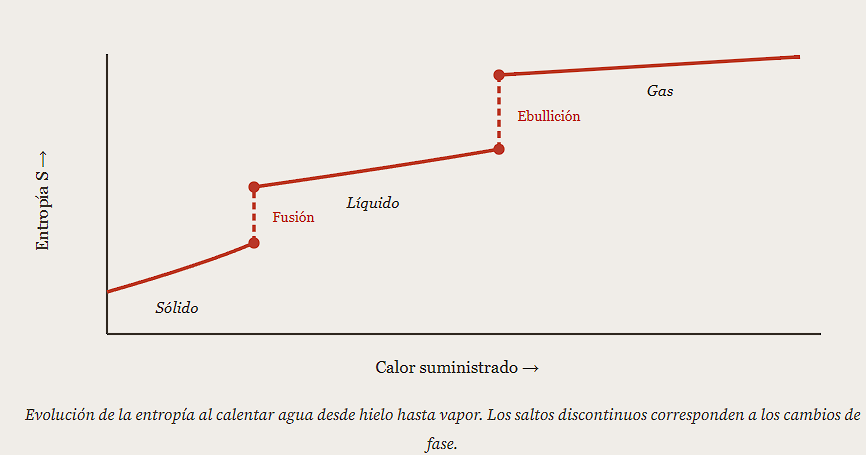

Para entenderlo de forma concreta, pensemos en un bloque de hielo muy frío al que vamos suministrando calor de forma continua. El sistema pasa por tres etapas bien diferenciadas.

Acto 1 — El sólido. Si partimos de temperaturas muy bajas, al dar calor al hielo su temperatura aumenta. Las partículas vibran cada vez más, pero la estructura cristalina se mantiene. La entropía aumenta lentamente, siguiendo una dependencia aproximadamente logarítmica:

?S ? C · ln(T? / T?)

donde C es la capacidad calorífica del material. El sistema sigue siendo ordenado, pero sus partículas tienen más formas posibles de moverse, así que la entropía crece.

Acto 2 — La fusión. Cuando el hielo alcanza 0 °C a presión atmosférica, algo distinto ocurre: la temperatura deja de subir aunque sigamos aportando calor. Ese calor no aumenta la agitación, sino que rompe los enlaces entre moléculas. El sistema pasa de sólido a líquido, y las moléculas adquieren libertad de movimiento. El salto de entropía es ahora:

?S = Q / T

donde Q es el calor de fusión y T la temperatura constante del cambio de fase. Aquí se ve con claridad la relación entre entropía y número de configuraciones posibles: el sistema pasa a un estado en el que las moléculas pueden disponerse de muchísimas más maneras.

Acto 3 — La ebullición. Una vez en fase líquida, la temperatura vuelve a subir al seguir añadiendo calor. Al llegar a 100 °C, otro cambio de fase: el líquido se convierte en vapor sin que la temperatura suba durante el proceso, y la entropía da otro salto aún mayor. En estado gaseoso, las moléculas se mueven libremente por todo el volumen disponible, y el cambio de entropía depende tanto de la temperatura como de la presión:

Gas ideal (aproximación) ?S ? C? · ln(T?/T?) ? R · ln(P?/P?)

donde C? es la capacidad calorífica a presión constante y R la constante de los gases. La entropía aumenta si sube la temperatura o si baja la presión (es decir, si el gas se expande). Un gas más caliente o más disperso tiene más maneras posibles de distribuir su energía.

La visión de Boltzmann: contando estados

La definición termodinámica (dS = dQ/T) fue formulada por Clausius en el siglo XIX. Pero fue Ludwig Boltzmann quien, décadas después, reveló su significado más profundo. Boltzmann demostró que la entropía es proporcional al logaritmo del número de microestados compatibles con el estado macroscópico del sistema:

S = k · ln(?)

donde k es la constante de Boltzmann (k ? 1,38 × 10?²³ J/K) y ? es el número de microestados posibles. Esta ecuación, grabada en la tumba de Boltzmann en Viena, unifica la termodinámica con la mecánica estadística.

Su mensaje es poderoso: un sistema tiene alta entropía no porque esté «desordenado» en el sentido visual, sino porque existe un número enorme de maneras microscópicas de estar en ese estado. El gas que llena una habitación tiene entropía alta porque sus moléculas pueden estar distribuidas de incontables formas. Un cristal perfecto a 0 K tiene entropía cero porque solo hay una configuración posible.

La entropía no mide desorden. Mide ignorancia: cuántas configuraciones microscópicas son indistinguibles desde el exterior.

El agujero negro: el caso extremo

Quizás el ejemplo más llamativo de por qué «entropía = desorden» es una analogía insuficiente es el de los agujeros negros. Un agujero negro parece un objeto tremendamente simple: solo se describe con masa, carga y momento angular. Y sin embargo, su entropía es gigantesca.

Cuando Bekenstein y Hawking aplicaron la termodinámica a los agujeros negros en los años 70, encontraron que su entropía es proporcional al área de su horizonte de sucesos:

S = k · A / (4 · l?²)

donde A es el área del horizonte y l? es la longitud de Planck. Las estimaciones actuales indican que la mayor parte de la entropía del universo observable está almacenada en agujeros negros supermasivos, y no en la materia ordinaria ni en la radiación.

Desde el punto de vista de Boltzmann, un agujero negro corresponde a un número astronómico de microestados posibles: toda la información sobre la materia que cayó en él queda codificada de maneras inaccesibles desde el exterior. No parece desordenado, pero lo es en el sentido estadístico más profundo.

La flecha del tiempo

El Segundo Principio de la Termodinámica establece que la entropía total de un sistema aislado nunca disminuye:

dS/dt ? 0 (sistema aislado)

Esto tiene una consecuencia filosófica profunda: es la única ley de la física que distingue el pasado del futuro. Las ecuaciones de Newton, las de Maxwell, las de la mecánica cuántica… todas son simétricas en el tiempo: funcionan igual hacia adelante que hacia atrás. Pero la entropía no. El café se enfría y no se calienta solo. La tinta se dispersa en el agua y no se concentra espontáneamente. Los huevos se rompen pero no se recomponen.

Esta irreversibilidad no es una ley fundamental separada: es consecuencia estadística de que los estados de alta entropía son incomparablemente más numerosos que los de baja entropía. No es que sea imposible que el café se caliente solo absorbiendo calor del entorno; es que la probabilidad de que todas las moléculas conspiren para hacerlo es tan ridículamente pequeña que en la práctica equivale a imposible.

En resumen: la entropía mide el número de maneras microscópicas en que puede realizarse un estado macroscópico. Los sistemas evolucionan hacia estados de mayor entropía simplemente porque esos estados son abrumadoramente más probables. Y esa tendencia irreversible es lo que llamamos la flecha del tiempo.

Conclusión

La entropía no es simplemente «desorden». Es una medida del número de configuraciones microscópicas compatibles con lo que observamos desde fuera. Crece porque los estados de mayor entropía son estadísticamente dominantes. Y su tendencia a crecer es lo que imprime dirección al tiempo.

Es, junto con la constante de la luz y la constante de Planck, uno de los conceptos más profundos de toda la física. Y tiene la virtud de esconderse detrás de lo más cotidiano: el café que se enfría, el azúcar que se disuelve, el universo que envejece.